Os personagens são programas de inteligência artificial, que usaram

estratégias diferentes para demonstrar um comportamento e ações típicas

de um jogador humano. [Imagem: Jacob Schrum]

Redação do Site Inovação Tecnológica - 27/09/2012

Robôs inteligentes

Dois jogadores virtuais ganharam o desafio BotPrize, convencendo um

painel de especialistas de que eles estavam sendo controlados por

humanos.

Os dois personagens são programas de inteligência artificial, que

usaram estratégias diferentes para demonstrar um comportamento e ações

típicas de um jogador humano.

O desafio é diferente do Teste de Turing clássico, que consiste em

fazer com que as máquinas demonstrem comportamento inteligente

fazendo-se passar por um humano em uma conversa com humanos.

O BotPrize consiste em fazer com que os agentes de software controlem personagens no jogo

Unreal Tournament 2004, um jogo de tiro em primeira pessoa.

"A ideia é avaliar nossa capacidade de construir robôs jogadores, que

são personagens controlados por algoritmos de inteligência artificial,"

explica Risto Miikkulainen, professor de ciência da computação na

Universidade do Texas.

Isso pode resultar não apenas em jogos melhores, mas também ajudar no

desenvolvimento de ambientes virtuais mais realísticos - para

treinamento e ensino - assim como para a construção de robôs que interajam com os humanos de forma mais natural.

Arma de julgamento

Os robôs têm que jogar uma partida, competindo entre eles e contra um

igual número de personagens controlados por jogadores humanos.

Cada jogador humano, além das armas normais do jogo, possui uma "arma

de julgamento", com a qual ele atira nos adversários para marcá-los

como humano ou robô.

Esta foi apenas a quinta vez que a competição foi realizada, e dois

robôs passaram pelo teste: o UT^2, programado por Miikkulainen, Jacob

Schrum e Igor Karpov, e o Mirrorbot, programado pelo romeno Mihai

Polceanu, atualmente fazendo doutoramento no Centro Europeu de Realidade

Virtual, na França.

Ambos receberam marcações de "adversário humano" em mais da metade

das vezes em que foram avaliados - o MirrorBot em 52,2% das vezes e o

UT^2 em 51,9%.

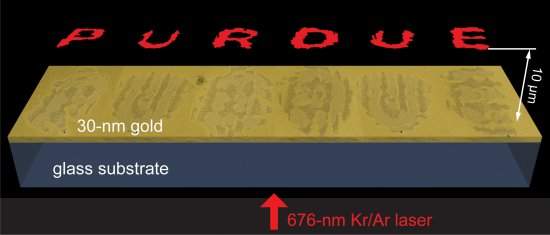

Troféu do BotPrize, superado apenas cinco anos depois de ter sido proposto. [Imagem: Peter Reynolds/BotPrize]

Imitando humanos

O Mirrorbot, como seu nome indica - robô espelho - imita o comportamento dos outros jogadores.

Ao se deparar com um adversário, o Mirrorbot observa seu

comportamento e, se não se sentir ameaçado, entra em um modo de

"interação social", simplesmente copiando as ações do seu companheiro

temporário, incluindo movimentos, modos de disparo, seleção das armas,

saltos e agachamentos.

O UT^2 também copia o comportamento dos adversários, mas somente em

um dos aspectos para o qual os programadores ainda não encontraram

solução: como se desviar de obstáculos.

Se para um humano parece óbvio que é necessário desviar de uma parede

antes de bater nela, ensinar um robô a fazer o mesmo é uma questão

ainda sem solução.

Para os demais comportamentos, o UT^2 usa algoritmos evolutivos, em

que cada versão do software seleciona "filhos" que herdaram as

estratégias que mais se parecem com as humanas.

Imitar em vez de recriar

O fato de que estratégias aparentemente tão simples tenham sido eficientes levanta algumas questões interessantes sobre a inteligência artificial

e as técnicas para fazer com que robôs se mostrem mais sabidos: "imitar

a turma" parece ser mais do que suficiente para parecer fazer parte da

turma.

De forma bastante interessante, apenas dois dos quatro participantes

humanos receberam mais de 50% de marcações de humano - um deles obteve

apenas 26,3%.

A conclusão desse sucesso desses robôs, fazendo-se passar por humanos

mais do que alguns humanos, é que o pragmatismo venceu as teorias.

Por exemplo, o Neurobot, um programa de inteligência artificial

estado da arte, baseado em um modelo da consciência humana, ficou em

quarto lugar, longe dos 50% necessários de "humanidade" - ele alcançou

apenas 26,1% de eficiência.